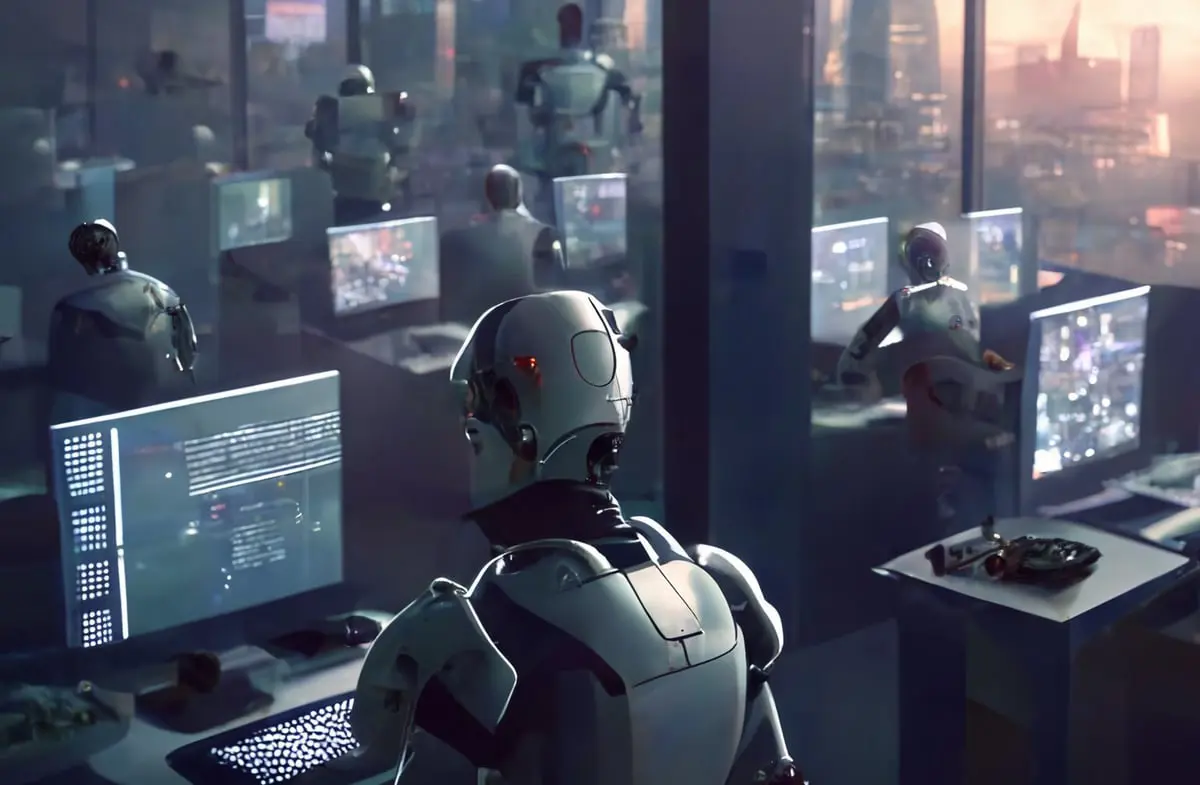

في ظل التقدم السريع في تكنولوجيا الذكاء الاصطناعي، طالبت النمسا يوم الاثنين ببذل جهود جديدة لتنظيم استخدام الذكاء الاصطناعي في أنظمة الأسلحة الذي يمكن أن يؤدي لظهور ما يسمى "الروبوتات القاتلة"، واستضافت مؤتمرا يهدف إلى إحياء المناقشات المتعثرة إلى حد كبير حول هذه القضية، وفق رويترز.

ومع ازدهار تكنولوجيا الذكاء الاصطناعي، فإن أنظمة الأسلحة التي يمكنها القتل دون تدخل بشري تزداد ظهورا ووضوحا، مما يثير تحديات أخلاقية وقانونية تقول معظم البلدان أنها تحتاج إلى من يتصدى لها في أقرب وقت ممكن.

معايير دولية

وقال وزير الخارجية النمساوي ألكسندر شالنبرج، خلال اجتماع شاركت فيه منظمات غير حكومية ودولية فضلا عن مبعوثين من 143 دولة: "لا يمكننا أن ندع هذه اللحظة تفوتنا دون اتخاذ إجراء. الآن هو الوقت المناسب للاتفاق على قواعد ومعايير دولية لضمان السيطرة البشرية".

وأوضح في خطابه الافتتاحي للمؤتمر، بعنوان "الإنسانية على مفترق الطرق: بأن أنظمة الأسلحة المستقلة وتحديات التنظيم"، علينا أن نضمن على الأقل أن القرارات المصيرية المتعلقة بمن يعيش ومن يموت تبقى في يد البشر وليس الآلات.

الروبوتات القاتلة

وقالت ميريانا سبولجاريك رئيسة اللجنة الدولية للصليب الأحمر، خلال حلقة نقاشية في المؤتمر: "من المهم للغاية أن نتخذ إجراءات على وجه السرعة".

وأضافت "ما نشهده اليوم في سياقات العنف المختلفة هو إخفاقات أخلاقية أمام المجتمع الدولي. ولا نريد أن نرى مثل هذه الإخفاقات تتفاقم من خلال تحويل مسؤولية العنف والسيطرة عليه إلى الآلات والخوارزميات".

ويتم استخدام الذكاء الاصطناعي بالفعل في ساحة المعركة. ويقول دبلوماسيون أن الطائرات المسيرة في أوكرانيا مصممة لمواصلة طريقها إلى هدفها حتى عندما يتم قطع الاتصال بينها وبين مشغلها باستخدام تقنيات التشويش.

أخطاء الذكاء الاصطناعي

وقال جان تالين، وهو مطور برمجيات ومستثمر في مجال التكنولوجيا في خطاب رسمي: "لقد رأينا بالفعل أن الذكاء الاصطناعي يرتكب أخطاء سواء كبيرة أو صغيرة، بدءا من الإخفاق في التمييز بين كرة القدم ورأس حَكَم أصلع، إلى وفيات المارة على الطرق بسبب السيارات ذاتية القيادة غير القادرة على التعرف على الأشخاص الذين يسيرون خارج الممرات المخصصة لهم".

وأضاف: "يجب أن نكون حذرين للغاية بشأن الاعتماد على دقة هذه الأنظمة، سواء في القطاع العسكري أو المدني".